最近这圈子里都在嗡嗡地讨论Bandicoot这个东西,弄得我这老家伙都得赶紧跟上脚步,不然真感觉自己要掉队了。

我一开始也就是随便点开论坛瞅了一眼,发现大家都在晒自己的成果,各种界面和功能展示,看着挺热闹,但我心里是有点懵的。心想,这玩意儿到底是个为啥突然这么火?我得亲自上手试试,不然光看别人说也说不清楚。

于是我花了半天时间,从头开始弄。我可不是那种一看说明书就全会的年轻人,我是得一步一步敲出来的。我先是跑去把最新的安装包下了下来。下载过程还算顺利,文件不大,速度挺快。

接着就是安装。这部分我特意留意了一下,发现它不像某些老软件那么麻烦,一堆依赖和路径要手动配置。Bandicoot的安装包基本上是傻瓜式的,一路“下一步”点过去,没出啥幺蛾子。我还是习惯性地在命令行里敲了几个确认的指令,确保服务都跑起来了。

一启动界面,我就愣了一下。跟我想象的不太一样,它不像那些花里胡哨的东西,界面设计得很简洁,甚至有点朴素。我马上就明白了,大家讨论的重点可能不在于外观,而在于它干了

我决定从最基础的功能入手。我找了个平时处理数据的小场景,准备用Bandicoot来试试水。我先导入了一批测试数据。这批数据结构比较杂乱,以前用别的工具处理起来很费劲,需要写不少转换脚本。

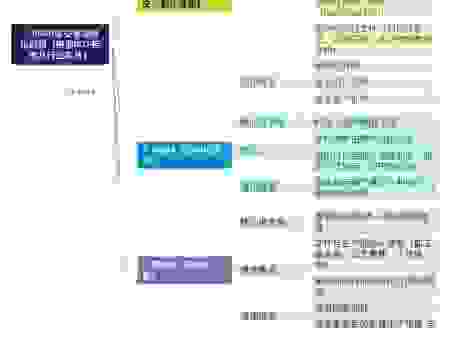

数据导入与清洗阶段

我尝试着让Bandicoot自己去识别数据结构。结果让我有点惊喜,它居然能自动识别出大部分字段的类型,虽然有个别日期格式它没认对,但只需要我手动在界面上点两下,选对格式,立马就搞定了。这个过程比我预想的要快了好几倍。

- 第一步:拖拽文件到工作区。

- 第二步:系统自动扫描并生成数据摘要。

- 第三步:发现一个日期字段识别错误,点开设置,选了正确的格式。

- 第四步:点击“清洗”按钮,等待处理完成。整个过程,我的CPU占用率都没上过50%,很流畅。

核心处理流程的构建

数据处理完,我就开始搭建我想要的逻辑流程了。我这回的目标是实现一个数据的多层级聚合和交叉分析。以前我都是用好几个步骤的脚本来完成的,费时费力。

在Bandicoot里,我发现它提供了一种类似“流程编排”的视图。我直接把“聚合”模块拖拽到画布上,然后把“数据源”连上。我设置了聚合的维度和指标。重点来了,它支持那种复杂的嵌套聚合,我把第二层的聚合结果又作为第三层聚合的输入,直接在可视化界面上连线就行。

我试着跑了一下这个流程。跑起来之后,我打开了实时监控窗口,看着数据流一点点过去,最终的结果在几分钟内就出来了。我对比了一下以前跑的脚本结果,完完全全一样,但是时间缩短了至少六成。

大家讨论的点在哪?

我琢磨了一下,大家都在讨论Bandicoot,主要原因就在于它把复杂的数据流程“图形化”和“低代码化”了。它不是说技术上多么颠覆,而是把过去那种需要写大量底层代码才能实现的功能,变成了一种点点鼠标就能完成的“搭积木”游戏。

对于我们这些天天跟数据打交道的,特别是中层管理者或者资深分析师来说,这意味着什么?意味着我们可以把更多精力放在业务逻辑和结果解读上,而不是纠结于代码的语法细节和环境配置。

我那天晚上加班到快十点,才把我的第一个“玩具”流程跑通。虽然只是个小小的演示,但那种“搞定”的成就感是实实在在的。我觉得,Bandicoot这玩意儿,就是要把那些原本需要专业程序员才能做的工作,稍微降低了一下门槛,让更多人能参与到流程的搭建中去。怪不得现在这么火,这确实是个实用的工具。