前几天闲来无事,刷到一个挺有意思的视频,说的是《星系之间会互相吞并吗?宇宙大餐正在上演》,看完之后我琢磨了一下,感觉这个事儿,还真挺符合我之前遇到的一些情况,所以今天就想跟大家唠唠我自己对这事的儿理解,也分享一下我的一些亲身经历。

说星系之间会不会互相吞并,这事儿想想就挺玄乎的,但科学上还真有这么回事儿。我接触到这个话题,得从我上家公司说起。那会儿我还在一家做数据分析的公司,每天跟海量的数据打交道,处理各种分析报告。有一次,我们接到一个项目,是要分析某个区域的地质构造和地下资源分布。为了做这个项目,我们得从好几个不同的数据库里提取数据,这些数据库,有的在公司自己的服务器上,有的在云端,还有的,是跟外部合作方共享的。这些数据,格式、字段都不太一样,处理起来真是费了老鼻子劲了。

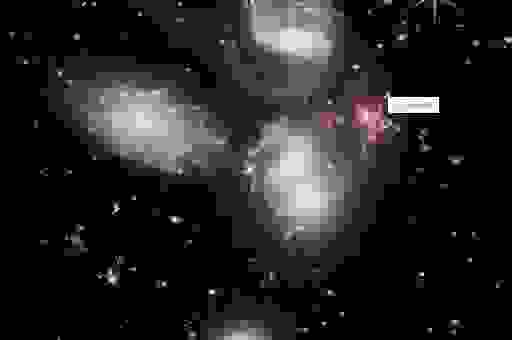

我记得最清楚的是,我需要把一个来自外部合作方的地理信息数据,跟我们自己本地存储的勘探数据合并起来。那个合作方的数据库,我当时都快被它搞疯了。它用的数据格式很老旧,而且有很多冗余信息,清理起来就跟大海捞针似的。我花了差不多一个星期,才勉强把数据整理能跟我们的数据对接上。这就像什么?就感觉我们自己的数据是银河系,而那个合作方的数据就像是仙女座星系,它们之间隔着十万八千里的距离,而且形态也不一样,要想让它们“融合”,得费好大劲。

数据世界的“星系吞并”

后来等我把数据初步整合准备进行分析的时候,又遇到了新问题。发现不同来源的数据,在时间维度上竟然对不上!有的数据记录的是几年前的,有的甚至是几十年前的,但对于地质构造来说,时间差异是很重要的。这就好像,我以为我把两个星系拉近了,结果发现一个星系还在过去,一个星系还在未来,怎么对齐是个大问题。

我们当时用的分析工具,也挺“古老”的,处理不了这么大规模、多维度的数据。我得自己写脚本,把数据一点一点地“挪腾”过来,再进行清洗、转换。为了解决这个时间维度的问题,我写了好几个Python脚本,把不同时间段的数据分别标记出来,然后根据地质演化的规律,进行推算和插值。这个过程,就像是两个星系在互相靠近,但又因为各自的运行轨迹不同,产生了各种“引力效应”,数据之间互相拉扯,就是不断的“摩擦”和“调整”。

最终,经过了大概将近一个月的时间,我总算是把这几个“星系”的数据给成功“吞并”了。虽然过程中磕磕绊绊,各种奇奇怪怪的问题都冒出来了,但分析出来的结果,还是挺令人满意的。我们成功地识别出了几个潜在的资源富集区,为公司后续的勘探提供了重要的依据。

过程中的“引力拉扯”

这事儿当时让我体会很深。你想,我们公司内部不同的项目组,他们之间的数据流动和整合,也常常会出现类似的情况。有的项目组用的技术栈不一样,数据存储格式也不同,就像是不同的星系。当我们需要把这些数据整合起来的时候,就得经历一个“吞并”的过程。这个过程不是一蹴而就的,而是充满了各种“引力拉扯”。

我记得有一次,我们需要从一个做市场营销的项目组那里获取用户画像数据,来辅助我们做产品推荐模型的优化。那边的用户画像数据,是以非结构化的文本形式存在的,比如用户的评论、反馈等等。而我们的模型,需要的是结构化的数值特征。这就像是,我们要把一个星云里的气体,变成一颗颗恒星。我当时就设计了一个流程,先用自然语言处理技术,把文本里的关键信息提取出来,然后转换成数值特征,再跟我们现有的用户数据库进行匹配和合并。

这个过程,光是提取关键信息就花了很长时间。因为用户的表达方式千奇百怪,有时候一句话里有很多歧义,需要我反复去调整算法的参数,让它能更准确地识别出用户的情感倾向、兴趣爱好等等。这期间,我还需要跟市场营销的项目组的同事不断沟通,了解他们的原始数据是怎么来的,他们是怎么理解这些文本信息的。这种沟通和调整,就像是两个星系在互相影响,你中有我,我中有你,但又保持着各自的独立性。

“宇宙大餐”何时休

当我看到“星系之间会互相吞并吗?宇宙大餐正在上演”这个标题的时候,我脑子里立刻就闪过这些画面。数据整合的过程,说白了,就是不同数据源之间的“吞并”和“融合”。每一个数据源,就像是一个小小的星系,它们有自己的规则、自己的形态。当我们需要把它们汇集在一起,服务于一个更大的目标时,就会发生一场“宇宙大餐”。

这场“大餐”的过程,充满了各种挑战。数据的格式不兼容、字段不匹配、时间维度不同步、质量参差不齐,这些都是“引力”在起作用,让数据之间互相排斥或者吸引。而我们要做的事情,就是像一个“宇宙级”的厨师,去解决这些问题,让这些原本分散的数据“星系”,能够和谐地融为一体,最终产生更大的价值。这个过程,有时候是平稳的,有时候却是惊心动魄的,充满了未知。不过每次成功“吞并”一个数据“星系”,那种成就感,也是真的挺让人满足的。